平差认为,或者说测量学的书籍认为,测量获得的值有一定的“误差”,需要进行“改正”,所以:

真值=观测值+改正值

而统计中和物理学中认为观测值是真值加上一些误差(或者称“噪声”)引起的,所以:

观测值=真值+误差

在摄影测量和数据处理的相关教材中沿用此规定。本文以统计的概念入手,所以沿用此规定,希望读者注意区别。

改正数和误差互为相反数。

- 函数关系:Y=f(X)

- 相关关系:Y=f(X)+ε

- 相关关系最直接的描述:散点图

- 如果X,Y两个随机变量的分布已知,总体的线性相关系数:ρ=var(X)var(Y)cov(X,Y)

- 实际上从统计的角度来讲,总体永远是未知的,即的样本的线性相关系数:γXY=∑(Xi−X¯)2∑(Yi−Y¯)2

∑(Xi−X¯)(Yi−Y¯)

- 样本相关系数是总体相关系数的估计,由于抽样波动,样本相关系数是随机变量,其显著性有待检验。

- 回归的现代意义:一个应变量对若干解释变量依存关系的研究

- 回归的目的:由固定的解释变量去估计应变量的平均值。

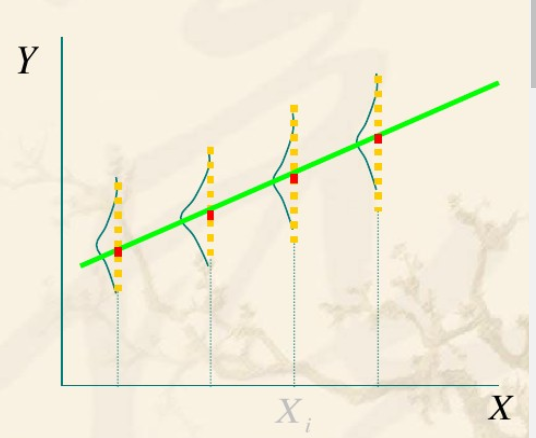

- Y的条件分布:当解释变量X取定(条件),Y的值不确定,由Y的不同取值形成一定的分布,即Y的条件分布

- Y的条件期望:对于X的每一个取值,对Y所形成的分布的期望,称为Y的条件期望E(Y∣Xi)

- 回归线:对于每一个X的取值,都有Y的条件期望E(Y∣Xi)与之对应,代表这些Y的条件期望的点的轨迹的直线或曲线,称为回归线。

- 回归函数:因变量Y的条件期望E(Y∣Xi)随解释变量X的变化而有规律的变化,将Y的条件期望表现为X的某种函数

E(Y∣Xi)=f(Xi)

这个函数称为回归函数。

回归函数分为:总体回归函数(PRF,总体已知)和样本回归函数(SRF,总体未知)。

- 总体回归函数的表现形式

- 条件均值的表现形式E(Y∣Xi)=f(Xi)=β0+β1Xi

- 个别值的表现形式:取定Xi,Y的各个别值Yi(样本)分布在条件均值E(Y∣Xi)周围,定义随机变量ui

ui=Yi−E(Yi∣Xi)即Yi=E(Yi∣Xi)+ui

- 线性回归模型的“线性”有两种解释:

- 对变量而言是线性的:Y的条件均值是X的线性函数

- 对参数而言是线性的:Y的条件均值是参数β的线性函数

线性回归模型主要指对参数而言是“线性”的

- 样本回归函数SRF

- 对于总体中的一个样本X=(X1,⋯,Xn),Y=(Y1,⋯,Yn),画一条直线拟合该散点图,这条直线称为样本回归线。

- 记样本回归函数为:

Y^i=f(Xi)=β^0+β^iXi

- 将样本回归线看做总体回归线的近似。

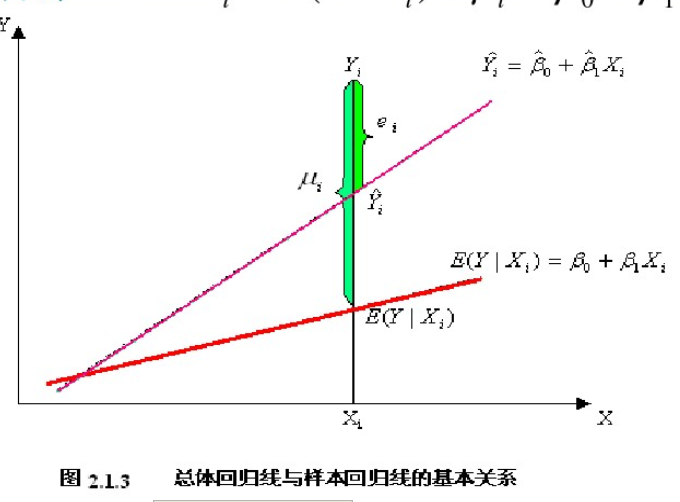

- Y^i=f(Xi)=β^0+β^iXi与Yi=E(Y∣Xi)+ui,则Y^i为E(Y∣Xi)的估计量

- β^i为βi的估计量。

- 样本回归函数的随机形式/样本回归模型

Yi=Y^i+u^i=β^0+β^1Xi+ei式中,ei称为残差(residual)。代表了其他影响Yi的随机因素的集合,可以看成ui的估计量u^i

- 关系示意图:

- 线性回归的模型的基本假设:

- 假设一:解释变量X是确定性变量,不是随机变量

- 假设二:随机误差项u具有零均值,同方差和无自相关。

- 假设三:随机误差u与解释变量X不相关

- 假设四:u服从零均值,同方差,零协方差的正态分布

u∼N(0,σ2In)

注意:如果假设1,2满足,则假设3满足。如果假设4满足,则假设2也满足

以上假设称为线性回归模型的经典假设或高斯假设,满足该假设的线性回归模型称为经典线性回归模型(Classical Linear Regression Model,CLRM)

在线性回归模型(Y,Xβ,σ2In)中:

Y=Xβ+ε

由于我们是站在观测之前的立场上,认为Y,ε是两个个随机向量(参数β不具有随机性,参数的估计β^才具有随机性),X是已知的。其中参数β,σ为待估参数,当Y值观测之后,ε的值也就只是β的函数,就可以对其求极值,进行最小二乘估计。

在间接平差(参数平差)中,一般将线性模型叫高斯—马尔柯夫模型(G-M模型),记为L~=L+Δ=BX~,D(L)=D(Δ)=σ02Q,称Q为协因数阵(权逆阵)。

- 经典线性回归模型https://wenku.baidu.com/view/a24e1bbd9e3143323968938f.html